A Artificial Analysis, organização independente especializada em benchmark de IA, anunciou uma reformulação significativa do seu principal framework de avaliação com o lançamento do Intelligence Index. A mudança mais relevante foi a remoção de três benchmarks consagrados — MMLU-Pro, AIME 2025 e LiveCodeBench — e a introdução de avaliações projetadas para medir se os sistemas de IA conseguem realizar o tipo de trabalhos reais.

Avaliação baseada em ocupações e setores econômicos

O objetivo central é mudar o foco da avaliação, saindo de testes abstratos ou acadêmicos e avançando para tarefas que refletem o trabalho real realizado por profissionais, numa abordagem mais próxima da realidade econômica.

As novas avaliações cobrem 44 ocupações distribuídas em 9 setores da economia, buscando medir se a IA consegue executar tarefas que, na prática, geram valor e renda no mercado de trabalho.

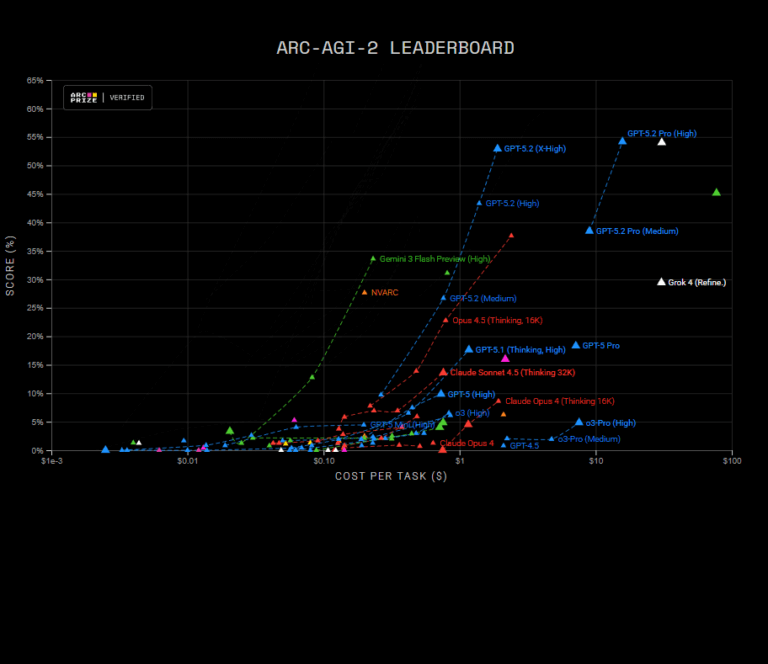

Enfrentando o problema da saturação de benchmarks de IA

A nova abordagem busca resolver um problema crescente no ecossistema de IA: a saturação dos benchmarks de IA tradicionais. À medida que os modelos evoluem rapidamente, testes clássicos deixam de acompanhar esse progresso, tornando-se incapazes de capturar diferenças reais de capacidade.

Isso ocorre porque os modelos líderes já atingiram níveis de desempenho tão elevados que as métricas clássicas deixaram de ser capazes de distingui-los de forma significativa. Quando vários modelos alcançam pontuações próximas do máximo, os rankings perdem relevância e deixam de indicar progresso real.

Quer saber mais sobre benchmarks e avaliação de IA? Acesse: Avaliação