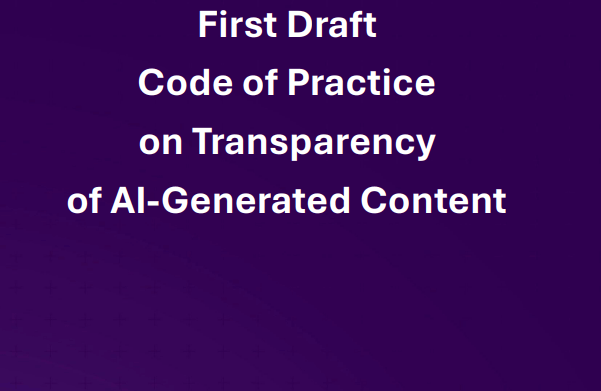

A Comissão Europeia divulgou o First Draft – Code of Practice on Transparency of AI-Generated Content, um documento estratégico sobre Transparência de Conteúdo Gerado por IA que antecipa como a UE espera operacionalizar, na prática, as obrigações previstas no AI Act.

O texto funciona como um instrumento de soft law: não é uma lei em si, mas estabelece padrões técnicos e organizacionais que tendem a se tornar referência regulatória e de mercado.

O foco central envolve identificar, rotular e detectar conteúdo gerado ou manipulado por sistemas de IA, preservando direitos fundamentais, liberdade de expressão e viabilidade econômica.

Responsabilidades de cada ator

O Código distingue responsabilidades conforme o papel de cada ator:

1. Provedores de sistemas de IA generativa:

- Design do sistema com mecanismos de transparência embutidos (transparency by design);

- Disponibilização de ferramentas de marcação e detecção;

- Documentação técnica acessível para autoridades e parceiros.

2. Plataformas e intermediários

- Detecção automatizada;

- Aplicação de rótulos visíveis;

- Cooperação com autoridades e pesquisadores.

3. Usuários profissionais

- Especialmente quando utilizam IA para fins comerciais, políticos ou informativos, espera-se conduta diligente na identificação de conteúdo sintético.

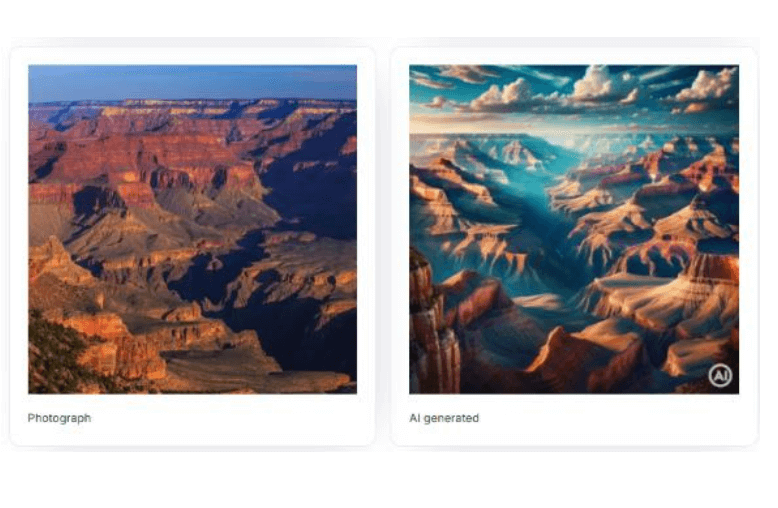

Marcação de Conteúdo Gerado por IA

O documento diferencia duas grandes abordagens:

Marcação explícita

- Avisos visíveis ao usuário (ex.: “conteúdo gerado por IA”);

- Adequados para contextos de alto risco, como notícias, publicidade política e comunicação institucional.

Marcação implícita

- Metadados, marcas d’água digitais ou sinais criptográficos;

- Invisíveis ao usuário comum, mas detectáveis por ferramentas técnicas;

- Consideradas essenciais para escalabilidade e interoperabilidade.

O Código reconhece que não existe solução única e defende uma abordagem combinada.

Detecção de Conteúdo Gerado ou Manipulado

A detecção é tratada como um processo probabilístico, não absoluto. O texto reconhece explicitamente:

- Limitações técnicas de detectores automáticos;

- Riscos de falsos positivos e falsos negativos;

- Necessidade de atualização contínua frente à evolução dos modelos.

Por isso, o Código recomenda:

- Transparência sobre margens de erro;

- Evitar decisões automatizadas com efeitos legais significativos baseadas apenas em detecção;

- Uso complementar de análise humana em contextos sensíveis.

Embora europeu, o Código de Transparência de Conteúdo Gerado por IA tende a produzir efeito extraterritorial, tornando-se referência para outras jurisdições e padrões privados.

Quer saber mais sobre deepfake? Acesse: Deepfake